PyTorch 中的 CocoCaptions (3)(PyTorch.CocoCaptions...)

请我喝杯咖啡☕

*备忘录:

- 我的帖子解释了cococaptions()使用带有captions_train2014.json、instances_train2014.json和person_keypoints_train2014.json的train2014、带有captions_val2014.json、instances_val2014.json和person_keypoints_val2014.json的val2014以及带有image_info_test2014.json的test2017, image_info_test2015.json 和 image_info_test-dev2015.json。

- 我的帖子解释了cococaptions()使用train2017与captions_train2017.json,instances_train2017.json和person_keypoints_train2017.json,val2017与captions_val2017.json,instances_val2017.json和person_keypoints_val2017.json和test2017与image_info_test2017.json和image_info_test-dev2017.json.

- 我的帖子解释了cocodetection()使用带有captions_train2014.json、instances_train2014.json和person_keypoints_train2014.json的train2014、带有captions_val2014.json、instances_val2014.json和person_keypoints_val2014.json的val2014以及带有image_info_test2014.json的test2017, image_info_test2015.json 和 image_info_test-dev2015.json。

- 我的帖子解释了cocodetection()使用train2017与captions_train2017.json,instances_train2017.json和person_keypoints_train2017.json,val2017与captions_val2017.json,instances_val2017.json和person_keypoints_val2017.json和test2017与image_info_test2017.json和image_info_test-dev2017.json.

- 我的帖子解释了cocodetection()使用train2017与stuff_train2017.json,val2017与stuff_val2017.json,stuff_train2017_pixelmaps与stuff_train2017.json,stuff_val2017_pixelmaps与stuff_val2017.json,panoptic_train2017与panoptic_train2017.json,panoptic_val2017与panoptic_val2017.json 和 unlabeled2017 以及 image_info_unlabeled2017.json。

- 我的帖子解释了 ms coco。

cococaptions() 可以使用 ms coco 数据集,如下所示。 *这是针对带有 stuff_train2017.json 的 train2017、带有 stuff_val2017.json 的 val2017、带有 stuff_train2017.json 的 stuff_train2017_pixelmaps、带有 stuff_val2017.json 的 stuff_val2017_pixelmaps、带有 panoptic_train2017.json 的 panoptic_train2017、带有 panoptic_train2017.json 的 panoptic_val2017 panoptic_val2017.json 和 unlabeled2017 以及 image_info_unlabeled2017.json:

from torchvision.datasets import CocoCaptions

stf_train2017_data = CocoCaptions(

root="data/coco/imgs/train2017",

annFile="data/coco/anns/stuff_trainval2017/stuff_train2017.json"

)

stf_val2017_data = CocoCaptions(

root="data/coco/imgs/val2017",

annFile="data/coco/anns/stuff_trainval2017/stuff_val2017.json"

)

len(stf_train2017_data), len(stf_val2017_data)

# (118287, 5000)

pms_stf_train2017_data = CocoCaptions(

root="data/coco/anns/stuff_trainval2017/stuff_train2017_pixelmaps",

annFile="data/coco/anns/stuff_trainval2017/stuff_train2017.json"

)

pms_stf_val2017_data = CocoCaptions(

root="data/coco/anns/stuff_trainval2017/stuff_val2017_pixelmaps",

annFile="data/coco/anns/stuff_trainval2017/stuff_val2017.json"

)

len(pms_stf_train2017_data), len(pms_stf_val2017_data)

# (118287, 5000)

# pan_train2017_data = CocoCaptions(

# root="data/coco/anns/panoptic_trainval2017/panoptic_train2017",

# annFile="data/coco/anns/panoptic_trainval2017/panoptic_train2017.json"

# ) # Error

# pan_val2017_data = CocoCaptions(

# root="data/coco/anns/panoptic_trainval2017/panoptic_val2017",

# annFile="data/coco/anns/panoptic_trainval2017/panoptic_val2017.json"

# ) # Error

unlabeled2017_data = CocoCaptions(

root="data/coco/imgs/unlabeled2017",

annFile="data/coco/anns/unlabeled2017/image_info_unlabeled2017.json"

)

len(unlabeled2017_data)

# 123403

stf_train2017_data[2] # Error

stf_train2017_data[47] # Error

stf_train2017_data[64] # Error

stf_val2017_data[2] # Error

stf_val2017_data[47] # Error

stf_val2017_data[64] # Error

pms_stf_train2017_data[2] # Error

pms_stf_train2017_data[47] # Error

pms_stf_train2017_data[64] # Error

pms_stf_val2017_data[2] # Error

pms_stf_val2017_data[47] # Error

pms_stf_val2017_data[64] # Error

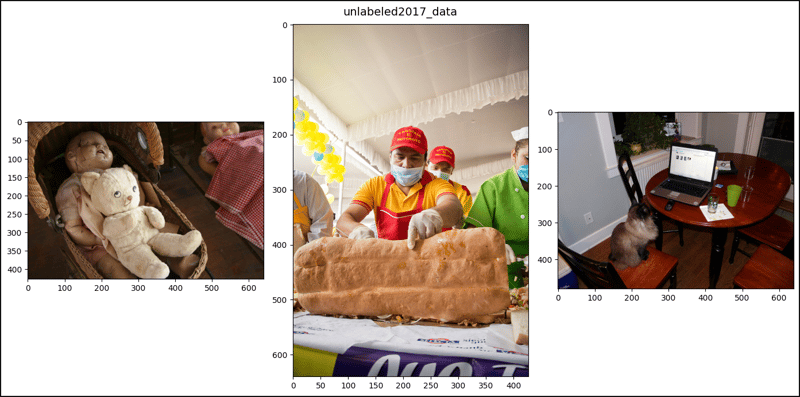

unlabeled2017_data[2]

# (<PIL.Image.Image image mode=RGB size=640x427>, [])

unlabeled2017_data[47]

# (<PIL.Image.Image image mode=RGB size=428x640>, [])

unlabeled2017_data[64]

# (<PIL.Image.Image image mode=RGB size=640x480>, [])

import matplotlib.pyplot as plt

def show_images(data, ims, main_title=None):

file = data.root.split('/')[-1]

fig, axes = plt.subplots(nrows=1, ncols=3, figsize=(14, 8))

fig.suptitle(t=main_title, y=0.9, fontsize=14)

for i, axis in zip(ims, axes.ravel()):

if not data[i][1]:

im, _ = data[i]

axis.imshow(X=im)

fig.tight_layout()

plt.show()

ims = (2, 47, 64)

show_images(data=unlabeled2017_data, ims=ims,

main_title="unlabeled2017_data")

以上就是PyTorch 中的 CocoCaptions (3)的详细内容,更多请关注知识资源分享宝库其它相关文章!